Dacă învăț cu AI, iau 10?

februarie 23, 2026

Poate AI să îți găsească un job? Strategii eficiente pentru tineri

martie 2, 2026Rezumat

Când întrebi „Cum gândește AI?”, de multe ori te referi la felul în care un sistem informatic ajunge să producă răspunsuri care par inteligente. În realitate, inteligența artificială nu are conștiință și nu înțelege lumea prin experiență, emoții sau intenții. Ea învață tipare din volume mari de date și calculează ce răspuns este cel mai probabil într-un context dat. În rândurile următoare vei descoperi cum a început domeniul inteligenței artificiale, cine i-a pus bazele, ce se află în spatele modelelor moderne (inclusiv modelele de tip Transformator), când a devenit relevantă pe scară largă și cum a ajuns să fie integrată și în România. Vei înțelege și de ce cresc atât de repede meseriile legate de AI și cum poți privi această schimbare cu luciditate.

Cum a pornit inteligența artificială și cine a pus bazele domeniului

În 1950, Alan Turing publică lucrarea Computing Machinery and Intelligence, unde propune un test practic pentru a discuta despre inteligența unei mașini. În loc să se blocheze în definiții, acesta a verificat un comportament: dacă o mașină poate susține o conversație scrisă astfel încât un om să nu poată distinge interlocutorul, atunci mașina trece un prag de „inteligență” în sens operațional. Ideea nu arată că mașina simte sau înțelege ca un om, ci că poate imita suficient de bine un dialog încât să pară inteligentă. Poți citi lucrarea originală aici: Computing Machinery and Intelligence (PDF).

Următorul reper major apare în 1956, când termenul artificial intelligence (inteligență artificială) este folosit într-un proiect de cercetare organizat la Dartmouth College. Propunerea proiectului este semnată de John McCarthy, Marvin Minsky, Nathaniel Rochester și Claude Shannon, iar ambiția lor este îndrăzneață: orice aspect al învățării și al inteligenței ar putea fi descris suficient de precis încât o mașină să îl poată simula. Dacă vrei să vezi documentul istoric, îl găsești aici: Dartmouth Proposal (PDF).

Apar laboratoare, conferințe, idei, finanțări. În primele decenii, AI este dominată de „inteligența simbolică”, adică programe care lucrează cu reguli și simboluri. În română, poți înțelege această direcție ca pe o încercare de a scrie manual „rețeta gândirii”: reguli de tip „dacă… atunci…”. Abordarea funcționează bine pentru probleme clar definite, dar se lovește de realitatea lumii care este plină de ambiguitate și excepții.

Apoi se naște un alt curent: învățarea automată sau machine learning. În loc să îi explici programului toate regulile, îi dai exemple, iar el învață tipare statistice. Din această familie face parte „învățarea profundă” sau deep learning care folosește rețele neuronale cu multe straturi. Saltul modern vine când se aliniază trei lucruri: date multe, hardware puternic (în special plăci grafice) și arhitecturi mai eficiente.

Originile AI: când știința a început să imite gândirea umană

Ce se află în spatele AI: rețele neuronale, tokeni și predicția următorului cuvânt

Când folosești un chat cu AI, ai impresia că vorbești cu o minte. Este o impresie utilă ca metaforă, dar periculoasă dacă o iei literal. Pentru multe sisteme moderne de limbaj, mecanismul central este predicția. Un „model de limbaj” învață să prezică următoarea unitate de text într-o propoziție. În engleză se numește token, iar în română îl poți traduce prin „unitate de text”. Un token poate fi un cuvânt întreg, o parte de cuvânt sau chiar un semn de punctuație, în funcție de sistem.

Imaginează-ți că scrii „Mâine merg la…”. Un model de limbaj calculează ce continuare este probabilă în funcție de tiparele pe care le-a învățat din datele de antrenare. „Serviciu”, „școală”, „piață”, „sală” sunt opțiuni plauzibile, iar modelul alege o continuare pe baza probabilităților.

Aici apare întrebarea importantă: dacă AI doar prezice, cum reușește să explice, să rezume, să scrie cod, să compună texte? Răspunsul este că predicția, făcută la o scară uriașă și cu un model suficient de complex, poate produce comportamente care seamănă cu raționamentul. În plus, sistemele moderne sunt ajustate pentru utilitate și siguranță, nu doar lăsate să completeze text brut.

Un exemplu foarte clar apare în raportul tehnic GPT-4, unde este spus explicit că modelul este de tip Transformator și este pre-antrenat să prezică următorul token, apoi este ajustat folosind feedback uman. În română, pretraining devine „preantrenare”, adică faza în care modelul învață tipare generale din date. Fine-tuning devine „ajustare fină”, adică adaptarea modelului pentru sarcini specifice. Iar RLHF, adică Reinforcement Learning from Human Feedback, se traduce „învățare prin întărire din feedback uman”, un proces în care oamenii evaluează răspunsuri, iar modelul învață să le aleagă pe cele mai utile și mai sigure. Vezi sursa: GPT-4 Technical Report (PDF).

Este esențial să știi și limita: un model poate „halucina”. În română, poți folosi termenul „halucinație” în sens tehnic: modelul produce o informație inventată, spusă convingător, atunci când contextul sau datele nu sunt suficiente. Nu o face din intenție, ci din mecanism: vrea să genereze o continuare coerentă, nu să verifice adevărul ca o enciclopedie.

Dacă vrei o formulare simplă pe care să o ții minte: AI nu gândește ca un om, ci calculează continuări plauzibile pe baza tiparelor învățate. Când calculele sunt bune și contextul este clar, rezultatul este util. Când contextul este vag sau ceri certitudini fără surse, apar erori.

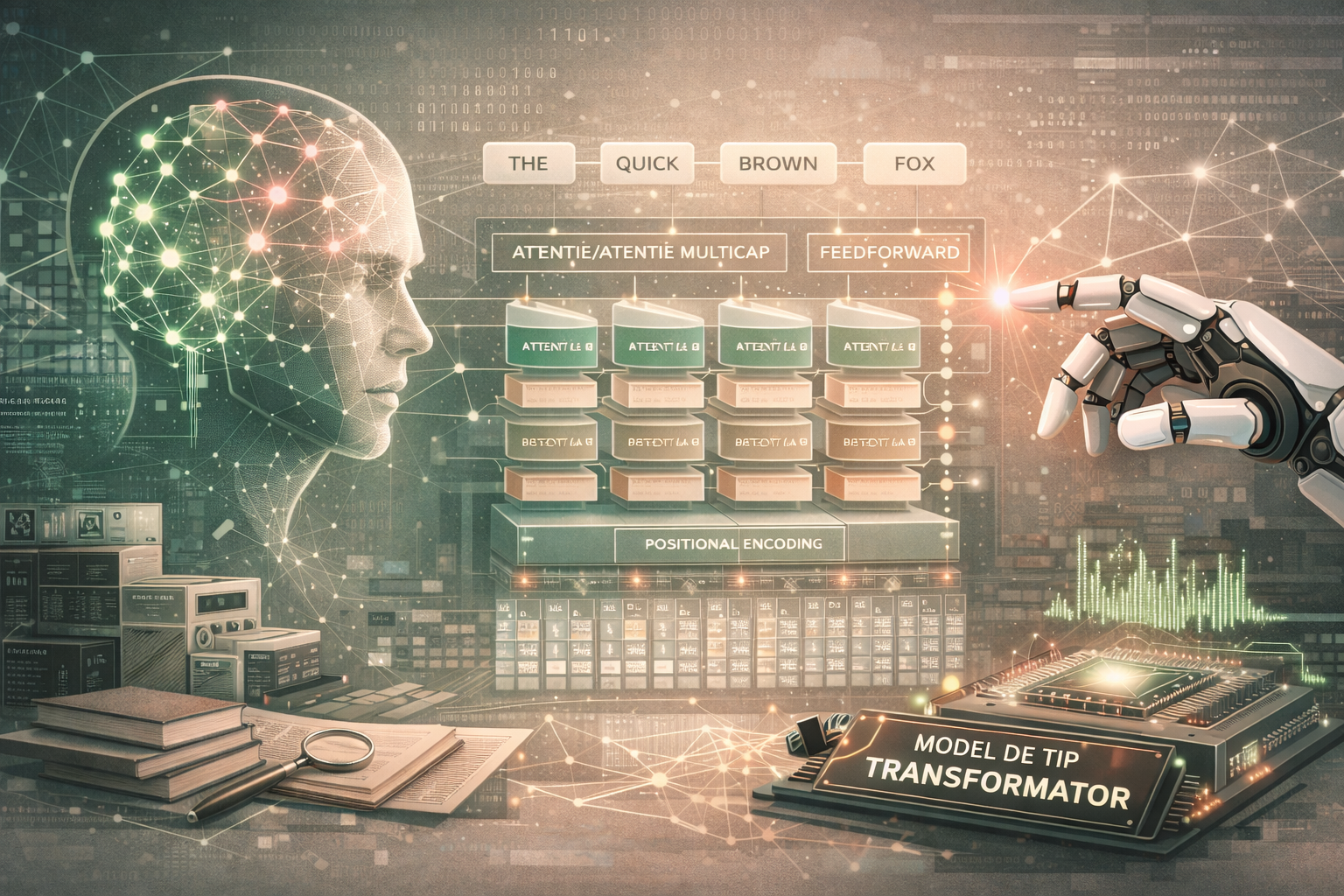

Ce sunt modelele de tip Transformator și de ce au schimbat totul

Un asemenea model este o structură de rețea neuronală propusă în 2017 în lucrarea Attention Is All You Need. Autorii arată că poți obține performanțe foarte bune în limbaj fără mecanisme mai vechi precum rețelele recurente, folosind în schimb un mecanism numit attention, adică „atenție”. Sursa originală este aici: Attention Is All You Need (arXiv) și varianta conferinței aici: PDF NeurIPS.

De ce au contat Transformatoarele atât de mult? Pentru că sunt eficiente la antrenare pe hardware modern și pot folosi context lung. Acest lucru a permis construirea unor „modele lingvistice mari” care învață din colecții uriașe de informații și pot fi adaptate pentru multe sarcini/prompturi.

Este important și să păstrezi o distincție sănătoasă: faptul că un model de tip Transformator poate genera explicații nu înseamnă că are o „minte” în spate. Are un mecanism puternic de potrivire a tiparelor și de compunere a textului, iar acest mecanism poate imita uneori un stil de raționament.

De la tokeni la predicție: mecanismul intern al modelelor Transformator

De când există AI în lume și în România și de ce cresc meseriile „de viitor” cu AI

În lume, reperele istorice sunt clare: 1950 pentru lucrarea lui Turing și 1956 pentru proiectul Dartmouth. Cu toate acestea, AI intră masiv în viața de zi cu zi mult mai târziu, când internetul, datele și puterea de calcul fac posibilă aplicarea pe scară largă.

În România, AI a existat de mult timp în cercetare și în companii, dar un semn major că domeniul devine prioritate națională este Strategia națională în domeniul inteligenței artificiale 2024–2027, aprobată prin Hotărâre de Guvern în iulie 2024, conform OECD. Poți consulta documentul publicat de autorități aici: Strategia națională IA 2024–2027 (PDF) și mențiunea OECD aici: OECD STIP: National Strategy for AI (Romania).

În același timp, România funcționează în cadrul UE, iar UE a stabilit regulile mari prin AI Act. Comisia Europeană notează că AI Act a intrat în vigoare la 1 august 2024: AI Act enters into force. Acest cadru legal înseamnă că adoptarea AI nu mai este doar despre performanță și cost, ci și despre risc, transparență și responsabilitate, mai ales în domenii sensibile precum educația, angajarea, sănătatea sau serviciile publice.

Acum apare întrebarea practică: de ce sunt căutate meseriile de viitor legate de AI chiar în perioada aceasta? Pentru că AI accelerează munca, reduce costuri și schimbă fluxuri întregi în companii. Când o tehnologie devine un multiplicator de productivitate, piața caută oameni care pot face trei lucruri foarte bine:

- să folosească instrumentele AI corect,

- să evalueze critic rezultatele,

- să integreze AI în procese fără să creeze riscuri inutile.

Raportul World Economic Forum despre viitorul joburilor pune accent pe transformarea pieței muncii până în 2030, inclusiv impactul tehnologiilor precum AI asupra rolurilor și competențelor. Îl poți consulta aici: The Future of Jobs Report 2025 (PDF). Pentru o perspectivă amplă, bazată pe indicatori și date, raportul Stanford HAI AI Index 2025 este o referință importantă: AI Index Report 2025 și PDF AI Index 2025.

Vei vedea tot mai mult cerere pentru:

- ingineri de învățare automată și specialiști în știința datelor (data science),

- ingineri care implementează AI în produse și automatizări,

- evaluatori și testeri de modele, inclusiv pentru corectitudine și siguranță,

- specialiști în guvernanță AI, conformitate și protecția datelor,

- profesioniști care folosesc AI ca instrument în domenii precum marketing, educație, suport clienți, analiză de business.

Dacă lucrezi în conținut sau marketing, avantajul apare când tratezi AI ca pe un instrument de lucru și îți păstrezi rolul uman acolo unde contează cel mai mult: sens, context, responsabilitate și verificare. AI îți poate propune variante, structură, idei, rezumate. Tu decizi ce este corect, ce este potrivit pentru public și ce respectă identitatea brandului.

Studenți pregătindu-se pentru carierele digitale cu ajutorul inteligenței artificiale

Q&A (5 întrebări frecvente)

1) AI înțelege ce îi spui?

În majoritatea cazurilor, nu înțelege ca un om. Un model de limbaj calculează continuări probabile ale textului pe baza tiparelor învățate, folosind tokeni ca unități de text.

2) De ce poate să ofere răspunsuri greșite cu multă încredere?

Pentru că este optimizat să genereze text coerent și util, nu să verifice adevărul în mod autonom. Când contextul este insuficient, poate produce informații inventate.

3) Ce este un model de tip Transformator, pe scurt?

Este o arhitectură de rețea neuronală introdusă în 2017 care folosește mecanismul de „atenție” pentru a lega părți relevante dintr-un text și pentru a lucra eficient cu context.

4) AI are emoții, intenții sau conștiință?

Nu. Poate simula empatie prin limbaj, dar nu simte și nu are scopuri proprii în sens uman.

5) Cum folosești AI în mod responsabil în UE și în România?

Eviți datele sensibile, ceri surse verificabile, verifici informațiile importante, documentezi procesul și ții cont de cadrul legal.

Concluzie

Întrebarea „Cum gândește AI?” primește un răspuns onest dacă schimbi ușor perspectiva: AI calculează, învață tipare și prezice continuări, iar acest lucru poate produce rezultate inteligente, din baze de date uriașe. Domeniul are rădăcini istorice solide, de la Turing și proiectul Dartmouth, iar valul modern a fost amplificat de modelele de tip Transformator care folosesc mecanismul de atenție pentru a lucra eficient cu limbajul. În România, direcția este susținută prin strategia națională 2024–2027 și prin cadrul UE oferit de AI Act.

În România, direcția este susținută prin strategia națională 2024–2027 și prin cadrul european oferit de AI Act, ceea ce arată că inteligența artificială nu mai este un experiment, ci o prioritate strategică.

Pentru tineri, această realitate deschide oportunități reale. Meseriile de viitor nu înseamnă doar programare avansată sau cercetare tehnică. Înseamnă competențe digitale solide, gândire critică, capacitatea de a lucra cu date și de a integra AI în procese concrete. Vor fi căutați dezvoltatori de soluții AI, specialiști în știința datelor, experți în securitate și etică digitală, dar și profesioniști din marketing, educație, design, comunicare sau antreprenoriat care știu să folosească inteligent aceste instrumente. Diferența o va face nu doar cine știe să utilizeze un instrument AI, ci cine înțelege cum funcționează, unde poate greși și cum poate fi folosit responsabil.

Inteligența artificială nu înlocuiește ambiția, creativitatea sau discernământul. Le amplifică. Pentru un tânăr care își caută direcția profesională, AI poate deveni un aliat puternic, cu condiția să fie privită ca un instrument de lucru, nu ca un substitut al gândirii proprii. Într-o lume în care tehnologia evoluează rapid, avantajul aparține celor care învață continuu și își dezvoltă competențe adaptabile, nu doar celor care cunosc un singur limbaj de programare sau un singur domeniu.